Dios ama a Anthropic, la gente odia a ChatGPT

Día de la mujer, Anthropic versus ChatGPT e IA en las escuelas

Muy buenos días y feliz lucha, como decimos en el Día Internacional de la Mujer. Bienvenidos a los recién llegados a este boletín, ayer pedí refuerzos para llegar a un número redondo y hoy ya somos 6,987 suscriptores 💪

Hoy es el Día Internacional de la Mujer. La fecha tiene diferentes raíces históricas: en 1910, la activista socialista Clara Zetkin impulsó su conmemoración internacional, y en 1917 una huelga de mujeres rusas que comenzó justamente un 8 de marzo marcó un punto de inflexión tanto en el feminismo como en los movimientos obreros. Un hito que también suele asociarse a la fecha es el incendio de la fábrica Triangle Shirtwaist en Nueva York, en 1911, donde murieron asesinadas -encerradas dentro de la fábrica- 146 trabajadoras en su mayoría inmigrantes.

En vez de hacer un especial, voy con dos recomendaciones unidas a lo digital:

Se estrena en cines de México el documental “Llamarse Olimpia” para contar cómo la historia de Olimpia Coral Melo, víctima de violencia digital se convirtió en el rostro de un movimiento feminista que transformó el marco legal desde América Latina, incluida Argentina. En algún momento llegará a MUBI.

Se estrenó en Filo News “Deepfakes e IA: la violencia digital contra mujeres y niñas que crece en Argentina”, un documental en el que participé que aborda diferentes casos de suplantación de identidad, deepfakes y extorsión sexual. Se retratan los casos argentinos de venta de imágenes íntimas falsas, creadas con IA, en colegios secundarios de todo el país. Participa la actriz y comediante Juli Savioli, víctima de esta práctica, Hernán Navarro, director de Grooming Argentina, y quien suscribe. Nos hicieron un deepfake impresionante. La producción del documental y su chequeo llevó meses de trabajo. La parte técnica estuvo a cargo de Lautaro Segafieno, de Filo News, que implementó un modelo de DeepFake en tiempo real. “Lo que se hace es entrenar un modelo o descargarlos. Existen páginas en las que te podes bajar el modelo entrenado o hacerlo por tu cuenta. Sí se necesita una muy buena computadora para entrenarlo, como hicimos nosotros. Luego de entrenar se genera el archivo DFM Models para reemplazarte la cara. La página que use para los paños del documental “MrDeepfakes” ya fue dada de baja”.

El domingo pasado no hubo boletín. Como sabrán, desde el sábado pasado, 28 de febrero, Estados Unidos e Israel llevan a cabo una ofensiva militar contra Irán.

Esto me atraviesa por varias razones: la información, la desinformación, la paz en el mundo y sobre todo que mi familia vive desde el año 2000 en Israel. Mi hermana en Eilat y mi papá en Ashkelon. Por esa razón me abrí de la discusión pública hace tiempo y estoy acostumbrada a asustarme de maneras que no se imaginan. En estos momentos de antisemitismo feroz, prefiero guardarme. Estudie mucho, leo un montón y también tengo muchas preguntas y pocas respuestas. Las fake news y la roña de la web la dejo para otro día.

Hoy me voy a dedicar a explicar un tema íntimamente relacionado con esto y es lo que está pasando con Anthropic, la empresa desarrolladora de la IA Claude y con OpenAI, la creadora de ChatGPT.

🕣 Este boletín tiene 3.000 palabras y lleva 14 minutos de lectura

📌 El viernes pasado salió el especial 14 de IA para suscriptores pagos y tocó Perplexity. Si te querés sumar, accedes a diferentes cursos escritos a lo largo del año. Más info aquí.

1. Todo lo que sube baja: un poco de historia

Estamos más polarizados que nunca. Si la semana pasada la mayor parte de la población no sabía lo que era Anthropic o Claude, ahora es el la empresa heroína de la ética en la IA. Pero momento. Recordemos que eso mismo era OpenAI antes de ser lo que es hoy: una organización orientada a investigación sin fines de lucro.

¿Recuerdan cuando Sam Altman, el actual CEO de OpenAI, era visto como el niño bueno de la red? Cuando co-fundó la empresa en 2015, la narrativa dominante lo presentaba como el emprendedor que quería que la IA fuera un bien público, con un modelo sin fines de lucro y énfasis en seguridad y “beneficio para la humanidad”.

A Elon Musk también se lo veía así en un principio. Ambos billonarios responsables -y creadores de Open AI- eran vistos como progresistas.

En noviembre de 2023, la historia empezó a cambiar. Tras varias semanas de llamadas secretas, la junta directiva de OpenAI acordó que Altman tenía que irse porque no se comportaba de manera sincera. En ese momento, sus compañeros de trabajo, sus empleados, salieron a su rescate publicando una carta abierta pidiendo su reincorporación. Los inversores, entre ellos Microsoft, se asustaron, y pidieron su regreso.

La historia es impresionante y la cuenta Karen Hao en el libro “El emporio de la IA”. En 2021, la hermana de Altman, Annie, lo acusó en redes sociales de haber abusado sexualmente de ella cuando era niña y presentó una demanda en su contra. Dicen Hao que Annie es una muestra impactante del daño que pueden hacer los discursos de Altman.

Recalco todo esto porque nos vemos constantemente aturdidos por discursos falsos en redes sobre los beneficios y el futuro de la IA. Lo que se conoce como humo nos está dañando la percepción pero además, aniquilando el pensamiento crítico. Estamos obnubilados por un par de millonarios malvados. La premisa del libro de Hao es que los gigantes de la IA dirigen un imperio, pero como cuenta la historia de la humanidad, los imperios, en algún momento, caen.

La hipocresía de la pausa de la IA: en 2023, todos ellos pidieron la pausa de la IA. Elon Musk y más de 1100 de expertos mundiales firmaron un llamado a hacer una pausa de seis meses en la investigación sobre inteligencias artificiales más potentes al advertir de “grandes riesgos para la humanidad”. En el sitio Future of IA se puede ver todas las luchas que van enfrentando desde la organización que dice centrar sus esfuerzos en temas de inteligencia artificial avanzada, IA militarizada, guerra nuclear y nuevas plataformas prosociales. No se nota y ahora, empezamos a ver las consecuencias.

2- ¿Chau ChatGPT? La campaña Anti OpenAI

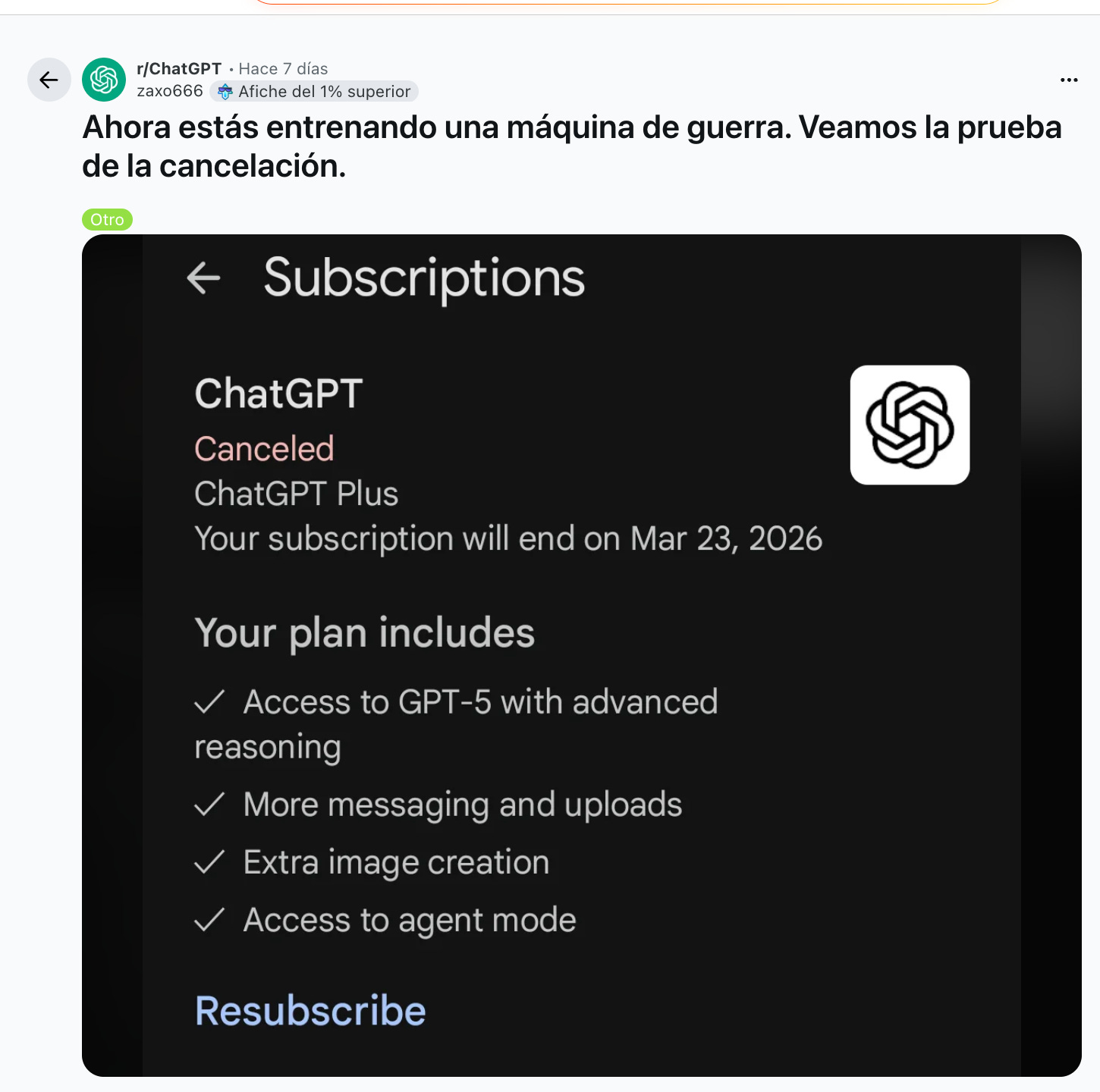

Cancelar ChatGPT es uno de los boicots más fáciles de llevar a cabo porque simplemente dejamos de pagar y de usar. Hay mejores alternativas para cambiar y, además, sentimos que hacemos algo por la humanidad.

Visita quitgpt.org. Cancela tu suscripción. ¿Usas la versión gratuita? Elimina la aplicación, porque tus conversaciones siguen alimentando la máquina. Luego, prueba una alternativa y dile a al menos una persona por qué.

La campaña se organizó a fines de enero de 2026 por una coalición de activistas en Estados Unidos que luego amplió la iniciativa a una más amplia que puntaba a "Resist and Unsubscribe", de las diez grandes plataformas tecnológicas durante el mes de febrero.

Pero pasaron cosas y cuando salió a la luz el acuerdo-desacuerdo-acuerdo de Anthropic con el gobierno de Estados Unidos, QuitGPT tomó más fuerza y apuntó solamente a dejar ChatGPT.

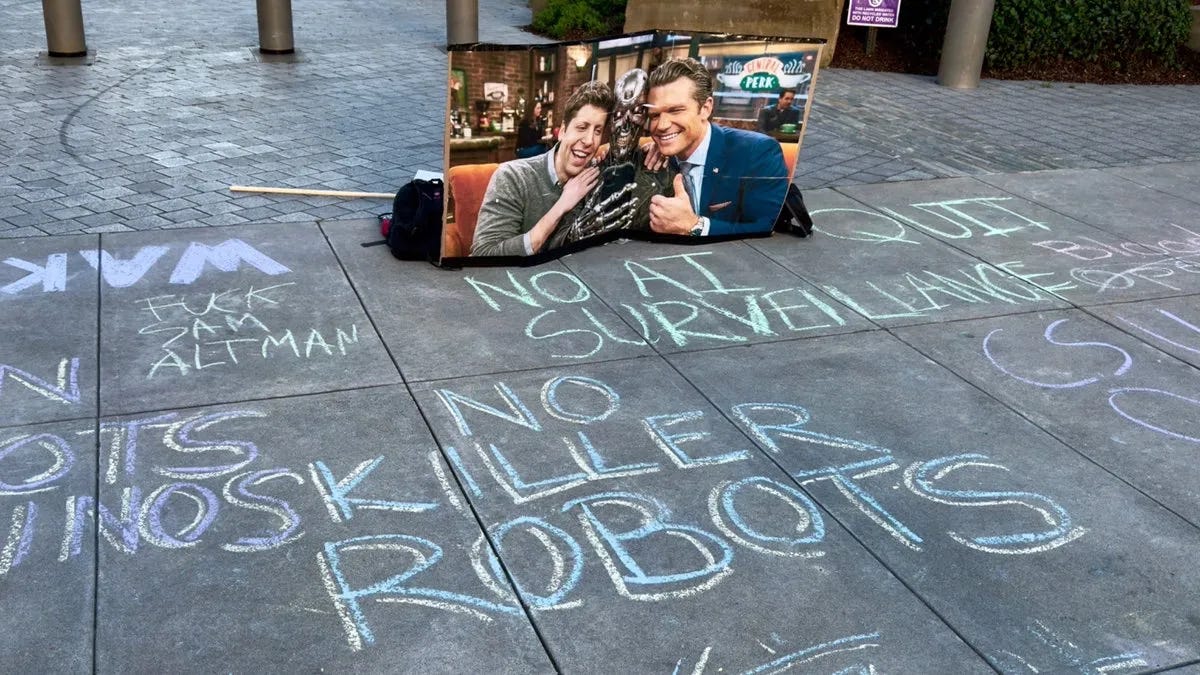

La aplicación Claude se disparó hasta convertirse en la más descargada para iPhone en Estados Unidos, según Sensor Tower. ChatGPT perdió miles de usuarios y las calles de Estados Unidos se llenaron de protestas analógicas.

Más de 2,5 millones de personas tomaron alguna acción (cancelar suscripciones, compartir el boicot en redes o firmar en quitgpt.org) y 1,5 millones cancelaron la aplicación. ChatGPT tiene aproximadamente 900 millones de usuarios semanales activos y 1,5 millones representa menos del 0,2% de su base.

Según Sensor Tower, las desinstalaciones de ChatGPT en EE.UU. saltaron un 295% el 28 de febrero respecto al día anterior, comparado con una tasa diaria habitual del 9%. Las reseñas de una estrella subieron un 775% ese mismo día.

Anthropic registró 503.424 descargas el 28 de febrero -su mayor cifra diaria histórica- y trepó desde el puesto 131 del 30 de enero hasta el número 1 de la App Store de EE.UU. el 1 de marzo, también liderando en Alemania y Canadá.

Además de Claude, indican en el sitio, instan a usar las alternativas de mayor privacidad y código abierto son Confer, Alpine y Lumo. Entre las opciones corporativas incluyen a Gemini y a Claude. No así a Grok: “Las grandes empresas están haciendo mucho más para facilitar el autoritarismo que las pequeñas empresas y los modelos de código abierto. Desaconsejamos firmemente usar Grok por razones obvias. La gente piensa que ChatGPT es el único chatbot disponible, y no saben que los ejecutivos de OpenAI son los mayores donantes de Trump. Es hora de cambiar eso”.

3. Cronología de un contrato: todo por un dólar

En agosto del año pasado, Anthropic le ofreció al entonces Departamento de Defensa norteamericano su herramienta por un valor simbólico de un dólar, lo mismo que había hecho OpenAI una semana atrás. Nada más metafórico que estar regalados ¿no?

En septiembre de 2025, el Departamento de Defensa de EE. UU. anunció la adjudicación de contratos por hasta 200 millones de dólares para el desarrollo de IA en Anthropic y también de Google , OpenAI y xAI de Elon Musk.

A principios de 2026, el coqueteo con la guerra prosperó aún más. Tanto OpenAI como Anthropic participaron en un concurso por un premio del Pentágono de 100 millones de dólares para producir tecnología para enjambres de drones autónomos controlados por voz. Esos drones, manejados por humanos, también podrían matar. De todos modos, la empresa de Amodei no fue elegida en esta ocasión. Sí en cambio fueron seleccionadas las propuestas de SpaceX y xAI.

A esta altura, Claude Gov ya estaba bien inserta dentro de los sistemas del Departamento de Guerra. Como cuenta Julieta Dussel en esta nota de Página 12, Anthropic no le vendió al Pentágono “acceso a Claude.ai”. Lo que hizo fue entregar el modelo en sí —el software, la tecnología— para que el Pentágono lo instalara y operara dentro de sus propias redes secretas, sin conexión al exterior para procesar documentos clasificados, analizar imágenes satelitales pero sin que la empresa tenga ningún control ni conocimiento sobre ese uso.

Como Anthropic sabía que no podría ver ni controlar qué haría el Pentágono con su modelo una vez instalado en esas redes, la empresa quiso que los límites de uso quedaran escritos en el contrato legal. Por eso el contrato original incluía dos prohibiciones concretas: la vigilancia masiva de ciudadanos estadounidenses y el uso en armas autónomas letales —es decir, drones o sistemas que pueden atacar blancos sin intervención humana directa. Durante meses esas cláusulas funcionaron sin conflicto.

El Pentágono integró a Claude con la herramienta Maven Smart System de Palantir y pusieron manos a la obra. Esos meses incluyeron la operación que capturó al presidente venezolano Nicolás Maduro. El sistema se había utilizado para generar objetivos propuestos, rastrear la logística y generar resúmenes de inteligencia sobre el terreno.

Hasta el momento no había habido quejas pero sí rumores. Uno de ellos, que cuando los muchachos de Anthropic se enteraron de que su herramienta había sido usada para matar gente en Venezuela, no les gustó. Pero esto no está confirmado. Lo que sí empezó a pasar es que el contrato tenía esas salvaguardas que le impedían al Pentágono actuar con total soltura.

El subsecretario de Defensa de EE.UU., Emil Michael, dijo que las restricciones éticas de Anthropic sobre el uso de su chatbot Claude eran un “obstáculo irracional” en un momento en que el ejército busca una mayor autonomía para drones, vehículos y otras máquinas para competir con rivales como China.

Ese obstáculo ya había sido resuelto por otras empresas de tecnología meses atrás. Por ejemplo, Alphabet eliminó la prohibición explícita de esta tecnología de sus normas internas hace exactamente un año. Reescribió sus directrices sobre cómo utilizará la IA, y borró una sección que anteriormente descartaba aplicaciones que “probablemente causaran daño”. El motivo esgrimido fue ayudar a la seguridad nacional.

Microsoft también confirmó su acuerdo con las armas autónomas, siempre y cuando un humano apriete el gatillo final. Amazon no tenía ninguna prohibición salvo un pedido de “uso responsable” y Palantir no tiene ningún problema en apretar ese gatillo o automatizarlo.

Afines de febrero, el Pentágono ya sabía que se venía otra operación y lanzó un ultimátum a Anthropic, la única compañía de IA que operaba con estos sistemas militares clasificados. La empresa tenía hasta el 27 de febrero para aceptar el nuevo acuerdo y si no, había una amenaza un poco contradictoria: una impediría que el gobierno utilice los productos de la empresa, y la otra obligaba a la empresa a permitir que el gobierno utilice dichos productos.

Lo cierto es que en la reunión previa al desastre. Como informó The New York Times el 24 de Febrero, Anthropic argumentó que estaba pidiendo garantías razonables de que su modelo Claude Gov no se utilizaría para la vigilancia de estadounidenses o en armas autónomas que no implicaran supervisión humana. El Pentágono, en cambio, quería que todos los contratos de inteligencia artificial estipulen que las fuerzas armadas pueden usar los modelos para cualquier propósito legal.

El plazo se acabó y el viernes 27 de febrero el Pentágono designó a la empresa y sus productos como un “riesgo para la cadena de suministro”. Es la primera vez en la historia que una empresa estadounidense recibe esa designación en Estados Unidos. Paralelamente, Sam Altman negociaba con el Pentágono para llegar a un acuerdo.

El 28 de febrero empezó la actual ofensiva con Irán. En la planificación del ataque, según informa Washington Post, el sistema inteligente del ejército Palantir Maven, impulsado por Claude, sugirió cientos de objetivos, emitió coordenadas de ubicación precisas y los priorizó según su importancia. La colaboración entre Maven y Claude era muy efectiva porque reduce la capacidad de contraataque de Irán y convierte semanas de planificación de batalla en operaciones en tiempo real.

Una columna de opinión del New York Times indicó que la tecnología de Anthropic sí se utilizó.

El Pentágono procedió a lanzar un ataque contra Irán, supuestamente con la ayuda de Claude, a pesar de que el presidente Trump había prohibido su uso apenas unas horas antes. Es posible que uno de los primeros objetivos fuera una escuela primaria en la que murieron al menos 175 personas. (Ni Israel ni Estados Unidos se han atribuido la responsabilidad del ataque).

Eso que a pesar de que Trump había ordenado que no se use ninguna herramienta de inteligencia artificial de Anthropic en operaciones militares pero el Pentágono no pudo hacer otra cosa porque Claude está demasiado dentro de los sistemas militares de Estados Unidos. Es más, habrá un plazo de seis meses para dejar de usarlo porque la IA implementada no se apaga con un interruptor.

Fue entonces que explotó la petición para boicotear ChatGPT que no solo ya reunió más de 2,5 millones de firmas, sino que generó un éxodo en masa de la plataforma de IA.

El 2 de marzo, luego de este blacklash, Sam Altman salió a aclarar-remendar en un extenso tuit lo hecho y dijo que OpenAI modificaría el acuerdo para garantizar que sus sistemas no se utilicen para la vigilancia nacional de ciudadanos estadounidenses, una cláusula no incluida en el acuerdo original.

Sin embargo, el 4 de marzo, en una reunión con todos los empleados de OpenAI, Altman dijo que su empresa no puede elegir cómo los militares utilizan su tecnología. También dijo, según la CNBC: “Así que quizás pienses que el ataque a Irán fue bueno y la invasión a Venezuela fue mala. No tienes derecho a opinar sobre eso”. Las decisiones operativas finales recaerán en el secretario de defensa norteamericano, Pete Hegseth.

Finalmente, OpenAI admitió que no tendrá límites éticos, solo legales.

4. Lo que vendrá: o me quedo o me voy

No se cuando estarás leyendo este boletín pero en este mismo momento están pasando cosas que no sabemos. Lo que informaron Reuters y Financial Times el 4 de Marzo es que Dario Amodei, el director ejecutivo de Anthropic y algunos de sus inversores (incluido Amazon) están intentando negociar una tregua con el Pentágono por la disputa sobre las salvaguardas de la IA. Si, dar marcha atrás para evitar la prohibición de la IA de Anthropic en todos los contratistas del Pentágono, pero pueden pasar dos cosas:

Antrhopic deberá ayudar al gobierno nortemericano a desmontar sus sistemas de IA del Departamento de Guerra.

O quedarse llegando a un acuerdo de uso.

Dario Amodei dice es que la tecnología aún no está lista y que sería peligroso. Según un documento interno visto por el Financial Times, Amodei le contó a sus empleados que el Pentágono ofreció aceptar los términos de Anthropic si eliminaban una frase específica sobre "análisis de datos adquiridos en masa". Eso era el escenario que más le preocupaba.

Al 8 de Marzo, lo más seguro es que Anthropic demande al Pentágono por designar a la empresa como un riesgo para la cadena de suministro.

Ahora queda todo en manos de Open AI. ¿Qué puede hacer el Pentágono con la inteligencia artificial de OpenAI? Cualquier cosa que sea legal. Pero legal, en Estados Unidos es, valga la redundancia, cualquier cosa.

Finalmente, Michael acusó públicamente a Amodei de ser “un mentiroso” con “complejo de Dios”. Michael, Amodei y Altman se conocen hace tiempo y, como verán, no se llevan bien.

Al cierre de esta edición, Caitlin Kalinowski, la jefa de robótica de OpenAI presentó su renuncia y compartió en X este mensaje (redactado por ChatGPT):

Renuncié a OpenAI. Me importa mucho el equipo de Robótica y el trabajo que desarrollamos juntos. No fue una decisión fácil. La IA desempeña un papel importante en la seguridad nacional. Pero la vigilancia de estadounidenses sin supervisión judicial y la autonomía letal sin autorización humana son líneas que merecían más reflexión de la que tuvieron. Se trataba de principios, no de personas. Siento un profundo respeto por Sam y el equipo, y estoy orgullosa de lo que construimos juntos.

El grupo de Ransomware Payload anuncia a Insacor como nueva víctima.

Qilin anuncia como nueva víctima de Ransomware a Grupo D’Arc.

Se publica a la venta una base de datos perteneciente al Centro de Empleados de Comercio de Posadas (CECPOSADAS) que contendría credenciales de usuarios, direcciones de correo electrónico, números de DNI, información de cuentas bancarias y registros relacionados con empresas y empleados afiliados.

📧 ¿Cansados del correo lleno? Te recomiendo Meco como suite de correo para escapar del mail lleno y leer newsletters sin tanto ruido. ¡Es gratuita! Si te anotás, contribuís con el news 🗞️.