No es X, es Y: cómo sobrevivir a la IA ✍️

Y por qué los detectores de escritura pueden fallar

Muy buenos días amigos. Sigo en la recta final de mi libro sobre Inteligencia Artificial pronto a publicarse por AZ Editora. Habrá presentación y también, ¡fiesta! porque este newsletter cumple tres años en breve 🥳. Eso si, no se cuándo pero en algún momento será. Si quieren auspiciar y/o colaborar con bebidas, guirnaldas, sanguchitos y tortas, me escriben.

A esta altura ya tengo tendinitis por escribir y escribir, en contraposición a lo que está pasando en internet y de lo cuál hablaremos hoy: ¿Todo es ChatGPT?

Esta comunidad es muy genial así que les doy la bienvenida a los que recién se suman. LadoBNews ya tiene más de 7.000 suscriptores y una tasa de apertura del 35%. Algunos lo leen religiosamente, otros acumulan y luego leen cuando pueden (¡soy de esas!) y otros no saben ni por qué les llega (es el mal de substack que se suscriben por recomendación) pero ojalá entiendan por donde va. No importa tener muchos seguidores sino que sean reales y ese es el problema de substack. Por eso, de vez en cuando, depuro a quienes no abren el news por más de seis meses. Los newsletteros abogamos por no hacer spam.

Es importante no delegar nuestras habilidades sino aprovechar las herramientas para tareas puntuales. Por otro lado, hay una resistencia de lo humano que percibe esto. También, un volver a lo presencial, al formato largo de escucha o lectura y a encontrarse cara a cara.

☕️ El viernes pasado, bajo la lluvia, estuvimos hablando dos horas en un precioso bar de caballito (Nika Café) sobre política e inteligencia artificial. Ya les había contado, porque tuve la visita estelar de una lectora del newsletter (¡hola Camila!) estudiante de periodismo pero también de mucha otra gente que se juntó a escuchar a la grosa de Natalia Romé y a quien suscribe debatir sobre estos temas, con la moderación de la genial Lucía Ríos. Lo más lindo fue que no se grabó. Nadie filmó. No hay registro y fue tan interesante lo charlado que será cuestión de dejarlo macerar en cada uno de los que participaron.

🎙️ El jueves pasado estuve de invitada también en el podcast “Se vive como el QLO” (gran nombre) con Ago Pagnotta, Manu Horazzi, Ce Kunsa, también en Caballito y también hablando más de una hora de actualidad a IA. Se puede ver aquí.

🕣 Este boletín lleva 10 minutos de lectura

☕️ Si querés apoyar mi trabajo o suscribirte a la comunidad (con material exclusivo de Inteligencia Artificial) podés hacerlo aquí en moneda nacional. En Abril saldrá la próxima edición de IA que es un especial de la IA Claude. En Substack, el sistema cobra en dólares.

1) No sos vos, es ChatGPT 🤖

La red está inundada de textos hechos con IA, pero también lo está tu casilla de correo, tus redes sociales, las respuestas a tus publicaciones. Nos convertimos en robots o empleados de las empresas de IA que no solo pagamos sus herramientas, sino que cedimos nuestra manera -mala o buena- de escribir a una espantosa manera de comunicarnos.

Lo peor es que suelen ser textos que bajan línea: nos explican algo, nos quieren inspirar o nos educan como usar tal o cuál cosa, usando algo muy mal. Desde un entrenador de perros hasta un psicólogo, un cocinero, una gacetilla de prensa y, por supuesto, un gurú de tecnología, inteligencia artificial y vida productiva. ¡Cómo hacer 1000 cosas en un segundo!

Que no cunda el pánico. Tengo ideas que puedan tomar o dejar y no, no les voy a dar hoy un prompt para que la IA no escriba como IA sino que voy a reivindicar no deelegar nuestra escritura a un modelo de lenguaje (LLM) porque, salvo excepciones, no tiene sentido. Podemos pedirle ideas, una estructura, que nos indique qué corregiría de un texto y en caso de que queramos que escriba por nosotros, habrá que chequear que no escriba tan mal como viene sucediendo.

Los LLMs que usan y abusan de lo siguiente:

—el guión largo ubicado en cualquier lugar de la frase—. Se usa para escribir bien, pero si antes no lo usabas, quizás es mejor volver a las comas bien puestas.

La estructura “No es X. Es Y. Es la peor, inunda la red escrita y hablada. Miren esta gacetilla de prensa:

La respuesta no está en la herramienta, sino en el criterio. A medida que la tecnología se integra en las estrategias de comunicación, se vuelve evidente que la diferencia no la marca la capacidad de producir más, sino la capacidad de decidir mejor. No se trata de qué se puede hacer, sino de qué vale la pena hacer —y por qué.

Tres ejemplos tres. La tríada de la IA está por todas partes.

El punteo como este que estoy usando pero de manera persistente

La palabra navegar, sumergirse, profundizar. También, anunciar lo que va a decir.

El adjetivo transformador y el cierre con moraleja: "En última instancia, lo más importante es..."

¿Tenés más? Te leo

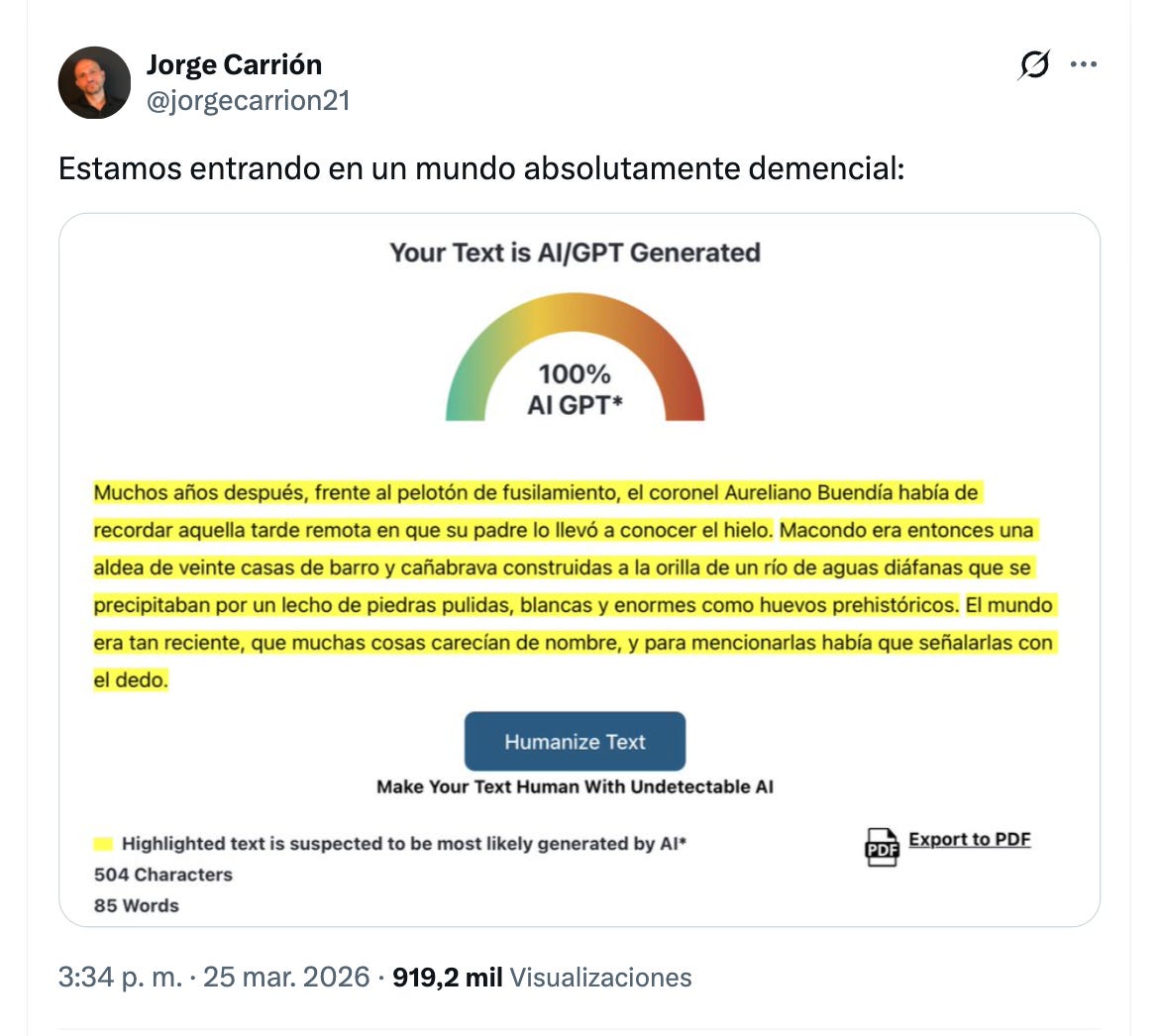

2) El viral de la semana: ¿Gabriel García Marquez es IA?

El estimadísimo Jorge Carrión compartió un tuit en X que se viralizó. Ese mismo día, el miércoles, ya varias personas me habían mandado, además de su publicación, otras similares.

Los detectores funcionan con patrones estadísticos que “confunden” una prosa muy pulida como la de García Márquez con la de un modelo de lenguaje. Inciden diferentes métricas y factores:

Índice de perplejidad: mide cuán predecible es el siguiente vocablo. Si la perplejidad es baja, el modelo es más seguro y sus predicciones coinciden con el texto real. Si la perplejidad es alta, el modelo está perdido y no logra predecir con éxito la secuencia.

La homogeneidad de estructura: cada párrafo cumple una función previsible, sin digresiones ni cambios de rumbo. La arquitectura interna es siempre la misma: introducción, desarrollo, cierre.

La repetición de patrones sintácticos: los LLMs recurren a los mismos conectores ("en este sentido", "cabe destacar", "en definitiva") y construyen una cadencia monótona que los delata.

La ausencia de errores, saltos de tono o irregularidades: Los seres humanos escribimos de manera más desprolija, aún corrigiendo un texto.

El índice de burstiness (ráfaga): mide la variabilidad en la longitud y complejidad de las frases. Los humanos alternamos frases cortas y contundentes con períodos largos. Los modelos funcionan como un metrónomo.

Esto ya lo habíamos discutido con la Constitución de Estados Unidos, cuya perplejidad es baja y el detector de IA falla. Pasa con la de Argentina y con los textos más populares de cada una de las lenguas existentes porque con eso se alimentó -robó- la IA para existir.

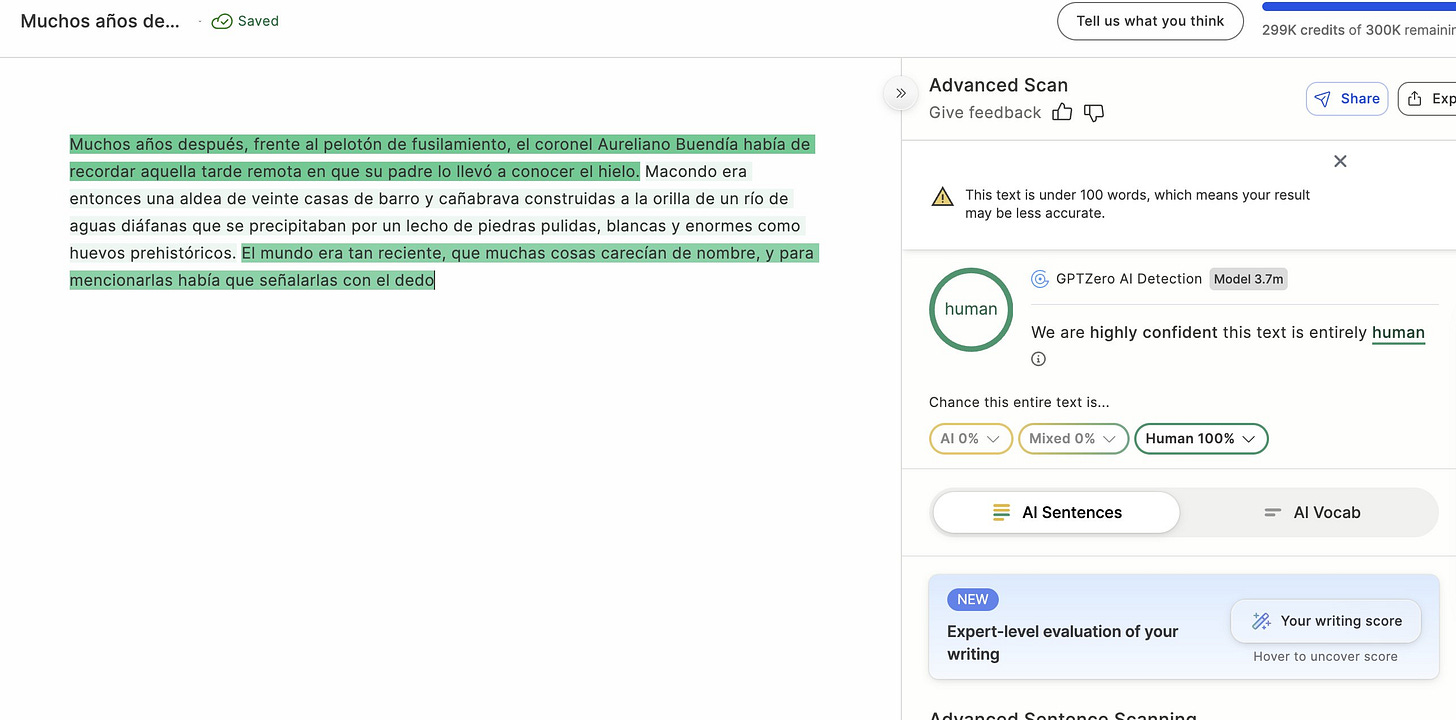

Hay muchos detectores, algunos mejores que otros. Mi favorito, GPTZero (porque tiene un programa de profesores embajadores que consiste en capacitar docentes de todo el mundo del cual formo parte porque también capacito y estudio) lo hizo mejor. Tiene, además, versión en español. Hice la prueba y me dio 100 humano%.

Lo bueno de todas estas herramientas no son sus detectores de IA, sino sus recursos para escribir mejor. Tienen generador de acrónimos, sinónimos, corrector gramatical, traductor de emojis y mil recursos más. Por ejemplo, Grammarly o este.

📌 Les dejo esta guía sobre cómo los profesores pueden incorporar la IA en su trabajo y escuelas. La publicó el 24 de marzo de 2026 el sistema escolar más grande de Estados Unidos conformado por 1600 escuelas.

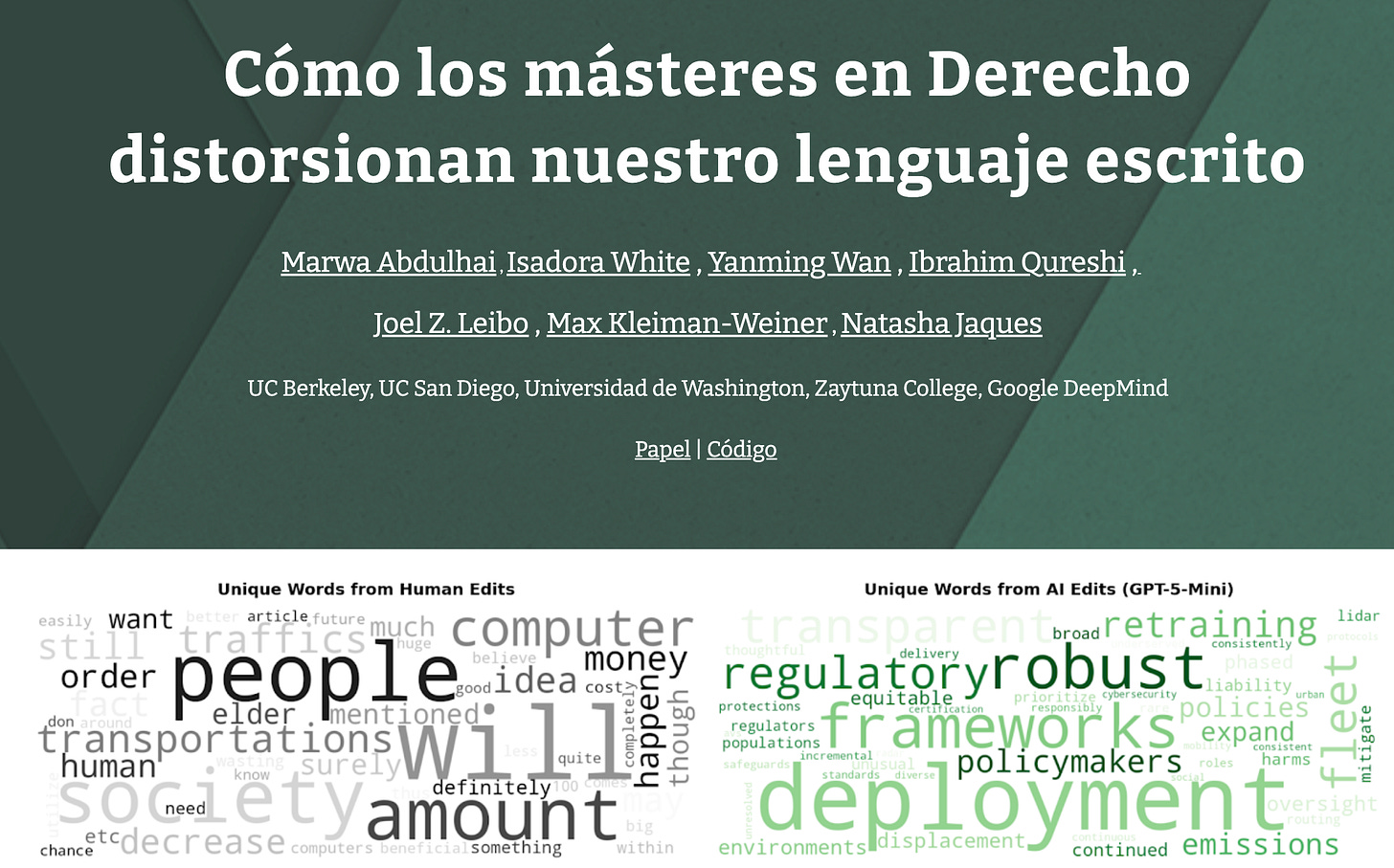

3) Cómo los LLM distorsionan nuestro lenguaje escrito

Lo más loco es que un verificador confunde un texto impecable con IA y lo que los modelos de lenguaje entregan, si no lo editamos o no lo trabajamos bien, es algo ilegible y claramente escrito por ChatGPT o similar.

Este trabajo analiza cómo los LLMs modifican nuestro lenguaje. Sin ir más lejos, al traducir automáticamente la página, ya cambia todo el significado, como verán en la captura de pantalla. Traduce LLMs por másteres en derecho 😆.

Los principales hallazgos del estudio son:

Los LLMs modifican las conclusiones de la escritura, cambiando tanto la postura como el tipo de argumento.

Los usuarios humanos reportan una paradoja de preferencias: se sienten satisfechos pero también reportan una pérdida de tiempo estadísticamente significativa de voz y creatividad.

Los LLM introducen cambios semánticos mayores que las ediciones humanas, incluso cuando solo se les pide que introduzcan correcciones gramaticales.

Eso precisamente noté al pasar fragmentos de mi libro para corregir con IA: les cambiaba el sentido, les achataba la manera de hablar y, a veces, daba vuelta los conceptos. Otras, funcionaba bien. Por eso, en la Conferencia Internacional sobre Aprendizaje Automático (ICML), que se celebrará en Seúl en julio, pusieron detectores de IA. Lo avisaron: no usen LLMs. finalmente, rechazaron 497 artículos (el 2% de las propuestas) porque sus autores infringieron las políticas de uso de la IA, como indicaron en esta entrada de su página.

Las estrategias para detectar el uso ilícito de IA fueron tres:

Pusieron una estrategia de marca de agua que selecciona frases específicas (como citas falsas o términos técnicos poco comunes) para que sirvan como señales detectables en las revisiones generadas por LLM.

Usaron técnicas de inyección indirecta de indicaciones (que incluyeron pistas de texto blanco, manipulaciones de fuentes e indicaciones crípticas) para incrustar instrucciones en los PDF de los manuscritos. Estas indicaciones son indistinguibles para los revisores humanos, pero son procesadas por los LLM cuando se carga el documento, lo que lleva al modelo a incrustar la marca de agua elegida en su salida.

Desarrollaron un método de detección estadística que identificaba marcas de agua incrustadas en múltiples revisiones, controlando la tasa de error familiar (FWER), sin depender de suposiciones sobre las revisiones escritas por humanos.

¿Por qué hicieron eso? No solo para demostrar que habían infringido las normas sino también para visibilizar que se necesita una guía clara sobre uso responsable de IA.

Miren qué interesante lo que dicen en este trabajo sobre como miden la revisión de pares.

4) El humano resiste

Miren esto que encontré. Human Fix: una bolsa de trabajo de desarrolladores humanos que arreglan las aplicaciones defectuosas que armaste con la IA.

Y este pobre señor que no quiere apretar el botón para que el robot cruce la calle para hacer una entrega. Lo subtitulé al castellano porque no tiene desperdicio (gracias Ale Bavera por nutrirme de este material precioso).

La cuenta Girsta cuenta que hay varios de estos videos que muestran la robot de entrega "Mingo" Serve Robótics parándose en un paso de peatones y pidiendo que un humano que pulse el botón de señal de paso para poder cruzar. El hombre responde con ira, despotricando sobre robots que reemplazan trabajos humanos y luego se aleja, dejando al bicho sin poder cruzar.

5) Los videos de IA que nos distorsionan la realidad

Casi uno de cada 10 de los canales de YouTube de más rápido crecimiento a nivel mundial muestra únicamente contenido generado por IA.

La basura de la IA es contenido de baja calidad, producido en masa y en general, inquietante. Puede ser realista o surrealista, más seguramente esta última opción. Pero tiene el famoso gancho que genera visualizaciones con el objetivo de ganar dinero a costa de tu asombro.

Hay de todo: melodramas con gatos humanizados, niños con respiradores artificiales en la plaza pidiendo dinero, falsos refugios de perros que colectan dinero para existir como “Patitas Elegidas", estafas emocionales de viudos o padres que perdieron sus hijos y mucho más.

Esta semana armé este video para explicar por qué el perro que imitaba a los pingüinos además de falso era peligroso.

Un seguidor me pasó el video de un medio de comunicación que publicó en IA un video falso del perro Rex despidiéndose de la policía federal (había video real y la noticia era vieja). El Diario Perfil replicó este video como cierto 🫠

Ya habíamos hablado aquí de la “enshittificación” de internet, el término que popularizó el escritor y analista tecnológico Cory Doctorow y que indica que las plataformas se llenan de contenido basura porque el negocio deja de ser el usuario y pasa a ser la publicidad y la escala.

Hay mucha gente que no identifica que estos videos son falsos. Y hay otra -lo cuál me parece más grave- a la que no le importa si es mentira o es verdad.

Miren estas gemelas siamesas que venden contenido sin revelar que son IA o estos refugios.

También hay niños genios.

Mis videos falsos favoritos son las remodelaciones de casas que tienen la particularidad de ser muy estrechas, o los jardines y patios descuidados, lavaderos de barrios populares que son intervenidos por varios obreros a la vez, con muchas escaleras, maderas y baldosas, y que, en un stop motion, transforman el lugar en algo supuestamente increíble. Pero el resultado suele ser inverosímil: sillones en los patios, maderas a la intemperie o cosas francamente horribles.

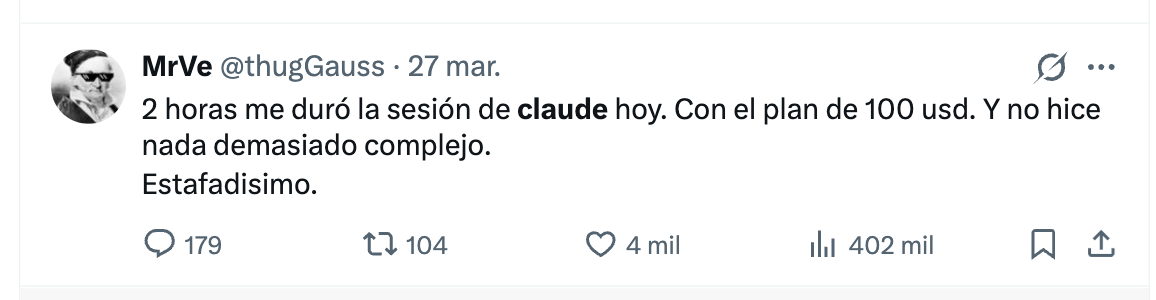

7) Claude se cayó: los memes de la semana

El amor por Claude duró poco. Esta semana, a la mayoría de los ahora denominados “Agente-boys” les limitaron los tokens que se usan para trabajar con Claude Code, encareciendo notablemente el valor de la herramienta.

Sumado a esto, Claude estuvo caída en varias oportunidades durante la semana. Y las redes, como ustedes saben, hablan por sí solas.

ESPACIO DE PUBLICIDAD

El grupo de Ransomware Crypto24 anuncia a Estudio O’Farrel como nueva víctima.

Filtran una base de datos perteneciente a la Universidad Nacional del Comahue.

Me viene pasando que recibo por LinkedIn solicitudes que parecen IA por su forma de escribir o el contenido del perfil // En un trabajo corporativo desarrollé un modo eficiente de escritura para manejar el volumen de chats y mails, siempre con una misma estructura, bullets, frases creativas de cierre. Algo similar a lo que describes que hacen los LLMs// Estoy haciendo un curso de Antrhopic sobre "IA fluency", es gratis, porque me está ayudando a pararme en el lugar correcto desde mi punto de vista: entender la IA, usarla con ojo crítico y ética. Aprender prompts y estar probando cada IA que sale no es viable y ocupa mucho tiempo.

Hola! De nuevo, gracias por el newsletter :)

Tengo un autocontrol sobre el consumo de redes. Utilizo IG y whatsapp pero ya no entro a estas apps por inercia y a veces (1 vez por semana o incluso más) entro a X. Youtube, solo para canales de stream o algún documental. Pero evito el contenido corto (debe haber un nombre más técnico, a mí me sale ese por el momento. Si alguien sabe, me viene bien aprender).

Es algo que me cuesta pero creo que vengo bien.

Qué quiero decir con todo esto? Que al estar alejada de la cotidianeidad de las redes, creo que doy cuenta más fácil cuando me cruzo con un video falso. Una vez vos dijiste que no hay que perder el sentido común. Debe ser un poco de eso, pero también otras variables que no logro dilucidar bien. Por ejemplo, soy docente, un niñx nunca se vería tan prolijo e impoluto en una foto. Mucho menos su alrededor después de terminar un producto creativo. Simplemente no existe eso, a menos que sea una publicidad de indumentaria o para un book de fotos.

Gracias Irina! Y vamos con la fiesta y ese libro!